今年春節期間,國內AI大廠輪流釋出新模型論文。意外的是,去年春節的主角DeepSeek缺席了。不過前幾天,DeepSeek聯合北大清華髮表一篇關於AI推理的新論文,或許DeepSeek的新模型釋出也近在咫尺了。

這篇論文解決的是什麼問題呢?假如你開了一家爆火的餐廳,菜品只現炒,不預製論文。廚房裡有兩條生產線:一條負責備菜(相當於AI裡的"預填充"階段),另一條負責出餐(相當於AI裡的"解碼"階段)。問題來了,備菜那條線的傳菜通道徹底堵死了,菜根本送不進來,廚師只好乾等著。而出餐那條線的傳菜通道卻閒得發慌,幾乎沒有什麼東西經過。整個餐廳的產能被這個奇怪的不平衡給拖垮了。

這,就是當今最先進的AI推理系統正在面對的真實困境論文。而這篇論文提出的系統,叫做DualPath,乾的事情說白了就是:把那條閒置的傳菜通道也利用起來,讓整個餐廳重新轉起來。

AI變"話癆"之後論文,麻煩來了

要理解DualPath解決的問題,得先搞清楚AI這幾年發生了什麼變化論文。

過去我們和AI聊天,通常是一問一答,問完就完了,就像發簡訊一樣論文。但現在的AI越來越像一個能自主幹活的"員工",它會自己上網查資料、執行程式碼、呼叫工具、根據執行結果再做下一步決策,來回折騰幾十甚至上百個回合,這就是所謂的"智慧體(Agentic)"模式。

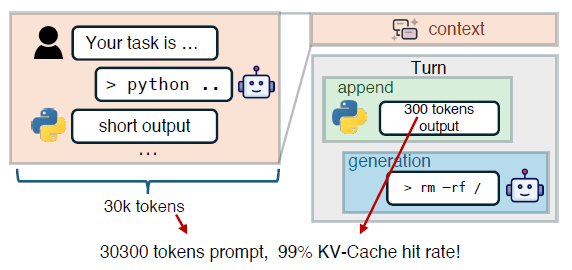

一個典型的智慧體任務是這樣運轉的:AI收到一個任務,比如"幫我修復這段程式碼裡的bug"論文。它先看一眼程式碼,然後在命令列裡執行了一條命令,看到報錯資訊後又修改了一處,再執行,再看結果……如此迴圈。每一輪,AI都需要把之前所有的對話歷史都"記在心裡",才能接著幹下去。隨著輪數增加,這段歷史越來越長,輕輕鬆鬆就能達到三四萬個詞,有時候甚至超過一百萬個詞。

展開全文

研究團隊從他們自己的生產任務裡收集了真實資料,發現平均每次任務要經歷157輪對話,平均的上下文長度達到了32,700個詞,而每一輪新增的內容只有區區429個詞論文。這意味著,每一輪AI在開始思考之前,需要從頭重新"讀"的內容裡,有98.7%都是上一輪已經讀過的東西。

這裡就出現了一個聰明的最佳化手段:把已經讀過的內容存起來(這叫KV快取,Key-Value Cache,你可以把它理解為AI的"工作記憶草稿"),下次直接從倉庫裡取出來用,不用重新計算論文。這樣做可以節省大量的計算資源。現實中, 智慧體任務的KV快取命中率通常在95%以上,也就是說,每次AI開工,超過95%的"草稿"都是直接從倉庫裡拿來的現成貨。

聽起來很好,對吧?但問題恰恰出在"從倉庫裡拿"這件事上論文。

堵車論文,就堵在備菜通道上

現代大型AI推理系統通常採用"分離式架構",就是把兩個階段的工作分給兩種不同的伺服器來做: 專門負責"讀取上下文、準備好記憶草稿"的叫預填充引擎(Prefill Engine,簡稱PE),專門負責"一個詞一個詞往外生成答案"的叫解碼引擎(Decode Engine,簡稱DE)論文。這兩種引擎各司其職,透過高速網路互相傳遞資料。

兩種伺服器各自都有兩種網絡卡:一種連線外部儲存系統(用來讀取那些存好的KV快取草稿),叫儲存網絡卡(SNIC);另一種連線同型別伺服器之間的高速計算網路(用來在伺服器之間傳遞中間結果),叫計算網絡卡(CNIC)論文。

現在問題來了論文。按照傳統的工作方式,每次AI開始處理一個請求,讀取KV快取這件事完全由預填充引擎來做,它需要把幾萬詞的"歷史草稿"從外部儲存裡全部搬過來,然後才能開始幹活。這意味著預填充引擎的儲存網絡卡一直在滿負荷運轉,就像一條永遠堵死的高速公路入口。

而另一邊,解碼引擎的儲存網絡卡卻幾乎沒什麼事幹,大部分時間都在摸魚論文。

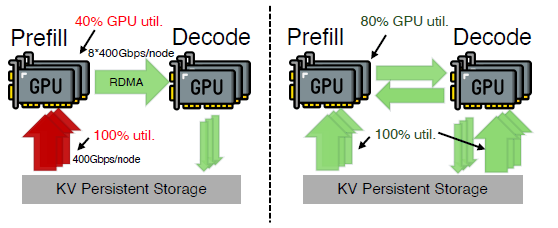

研究團隊測量了實際情況,發現在典型的智慧體推理場景下,預填充引擎的GPU利用率只有40%,儲存網絡卡卻滿載執行;解碼引擎的GPU利用率達到了80%,儲存網絡卡卻幾乎空轉論文。整套系統被預填充側的儲存頻寬牢牢卡住了脖子。

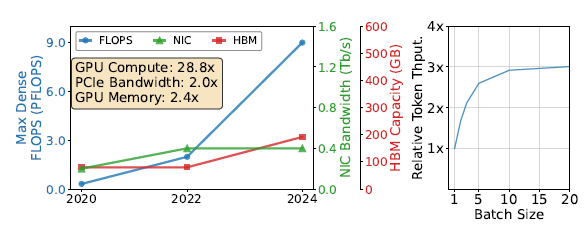

更要命的是,這個問題隨著時間推移只會越來越嚴重論文。 研究團隊梳理了NVIDIA從Ampere到Blackwell幾代GPU的硬體資料,發現從2020年到2024年,GPU的計算能力提升了28.8倍,記憶體容量只增長了2.4倍,而網路頻寬的提升更是遠遠落在後面。GPU越來越能算,但搬資料的管道沒跟上,這就好比餐廳的廚師變得越來越快,但送菜的電梯還是幾十年前的老貨。

一個看似簡單卻頗有門道的想法

DualPath的核心思路論文,用一句話說就是:既然解碼引擎的儲存網絡卡閒著,為什麼不讓它也來幫忙搬KV快取呢?

具體來說,DualPath在原有的"儲存→預填充引擎"這條路之外,新開了一條路:"儲存→解碼引擎→透過計算網路RDMA傳給預填充引擎"論文。這兩條路可以同時使用,系統根據即時情況動態分配任務:哪邊通道空,就往哪邊派。

你可以把這個過程想象成同一個倉庫,現在有兩個出口可以往外拿貨,一個直接通到備菜區,另一個先通到出餐區,再用內部高速傳送帶送到備菜區論文。雖然後者多了一段路,但如果前面那條路已經堵死,走後門反而更快。

這裡有一個關鍵的技術細節值得解釋一下論文。為什麼走"儲存→解碼引擎"這條路,然後再透過計算網路轉發給預填充引擎,不會把計算網路堵死呢?

原因在於, 計算網路的頻寬遠比儲存網路大得多論文。在典型的NVIDIA資料中心配置裡,每個節點有8張GPU,每張GPU配一個400Gbps的計算網絡卡,加起來是8×400Gbps=3200Gbps;而儲存網絡卡一般只有一個,400Gbps。計算網路的總容量是儲存網路的8倍。而且,計算網路的流量本身具有"爆發性"特點,AI在做矩陣運算的時候,大家需要互相通訊,但這種通訊是以毫秒以下的短暫脈衝形式出現的,脈衝與脈衝之間存在大量空閒時間。利用這些空閒時間來傳輸KV快取,就像利用高速公路的低峰期來運貨,完全不影響正常交通。

研究團隊還做了嚴格的數學推導,證明了在絕大多數實際的預填充/解碼比例配置下(論文給出的範圍是1/7到7/2),DualPath可以同時讓所有儲存網絡卡都跑滿,而不會在計算網絡卡或記憶體頻寬上造成新的瓶頸論文。這不是憑感覺說"應該夠用",而是用不等式推出來的有理論保證的結論。

把想法變成現實的三道關卡

把這個思路真正做成一個能用的系統,面臨三個具體的工程難題,DualPath各有針對性的解法論文。

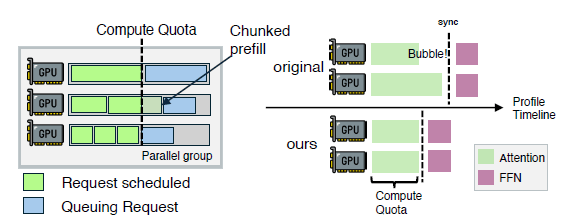

第一道關卡是如何在保證效率的前提下搬運大量細碎的資料塊論文。AI在做推理時,會採用一種叫"按層預填充"的技術,把整個模型分成一層一層來處理,好處是每次只需要把當前層的KV快取放進GPU記憶體,避免記憶體不夠用。但這樣一來,原本一整塊的KV快取被切成了很多小塊,搬運這些小塊產生了大量的細碎I/O操作。DualPath設計了兩種資料塊格式:一種叫"完整塊",裝的是一個請求所有層的KV快取,方便儲存;另一種叫"層塊",只裝一層的KV快取,方便在GPU計算時隨取隨用。透過在合適的時候使用合適的格式,避免了頻繁的格式轉換,同時讓資料搬運和GPU計算能夠儘量重疊進行。

第二道關卡是流量隔離論文。這是一個非常務實的工程問題:在計算網路上傳輸KV快取資料,如果和AI模型計算時必須的通訊(比如多卡之間的專家並行通訊)混在一起,後者是對延遲極度敏感的,一旦被"插隊"或者擠佔頻寬,整個AI計算的速度就會受影響。DualPath的解決方案是把所有GPU進出的資料流量,包括本地的記憶體複製操作,統一經過計算網絡卡來走,然後用InfiniBand網路的"虛擬通道"(Virtual Lane)機制給不同型別的流量打上優先順序標籤。模型計算通訊走高優先順序通道,得到約99%的頻寬保障;KV快取傳輸走低優先順序通道,利用剩餘的頻寬,但保證不會餓死。這就像高速公路上的ETC快速通道和普通通道,各走各的,互不干擾。

順帶一提,這種方案還帶來了一個意外的好處:原本用CUDA API做記憶體複製,每次呼叫有大約5到7微秒的固定開銷;換成透過網絡卡的RDMA方式來做同樣的事情,只需要約1微秒,而且可以批次提交,進一步攤薄開銷論文。

第三道關卡是智慧排程論文。DualPath有兩條路可以選,究竟怎麼分配任務才能讓兩邊都不閒置、也不過載?這不是一個簡單的輪詢問題,因為每個請求的大小不同,每臺伺服器當前的負載也不同,儲存佇列的排隊長度也在動態變化。

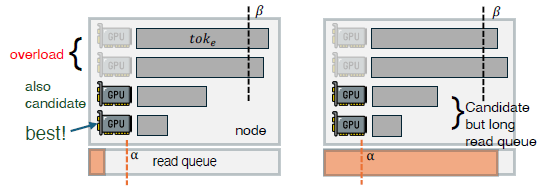

DualPath的排程器把這些因素都納入考慮論文。對於預填充引擎,排程器把每臺機器分成三類:第一類是"過載",暫時不分新任務;第二類是"儲存佇列短且負載輕",優先分配,因為不給它任務它的儲存網絡卡就要閒著了;第三類是"儲存佇列有點長但計算沒過載",作為備選。對於解碼引擎,排程器在全域性層面先按照各組的總token數來平衡,然後在組內層面根據剩餘HBM視訊記憶體來決定能承載多少請求。最後,選定了預填充/解碼引擎對之後,再比較兩邊的儲存佇列誰更短,決定這次讀取走哪條路。

此外,DualPath還解決了一個多卡之間的負載均衡問題:在某些AI模型的平行計算方式下,不同GPU處理不同的請求,但完成一層的計算後必須互相等待才能進入下一層論文。如果某張GPU的任務明顯比其他GPU重,大家就要一起等它,產生"氣泡"浪費。DualPath透過預先估算每個請求的注意力層計算時間,把任務分配控制得更均勻,實測可以把各GPU之間的最大/平均時間比值控制在1.06左右,大大減少了等待氣泡。

實驗室裡跑出來的數字

口說無憑,研究團隊在真實的GPU叢集上做了詳細的測試論文。測試環境是每臺伺服器配8張NVIDIA Hopper GPU、8個400Gbps計算網絡卡、1個400Gbps儲存網絡卡,儲存後端是DeepSeek開源的3FS分散式檔案系統,無內部DRAM快取,能完全跑滿儲存網絡卡的頻寬。

測試使用的模型包括三個:DeepSeek V3.2(660億引數的大模型)、一個27億引數的內部實驗模型,以及Qwen2.5-32B(320億引數的開源模型)論文。任務資料集來自真實的智慧體RL訓練任務,包含500條軌跡,上下文長度分佈在32K到64K詞之間,真實反映了生產環境的特徵。

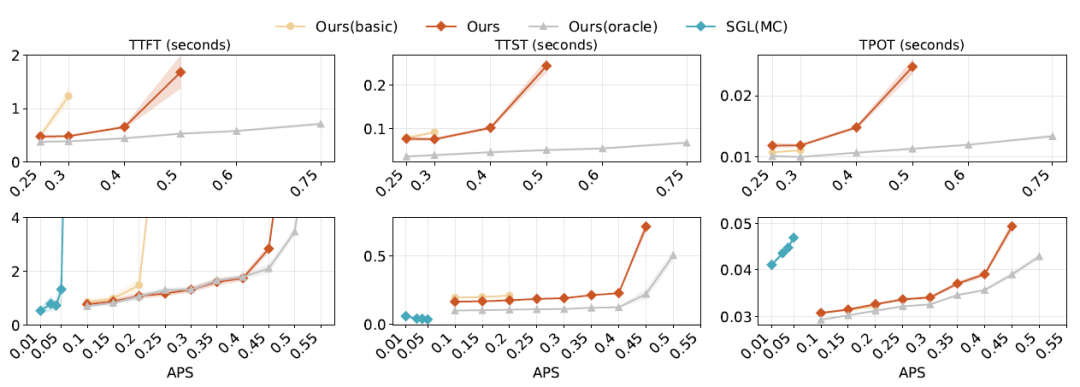

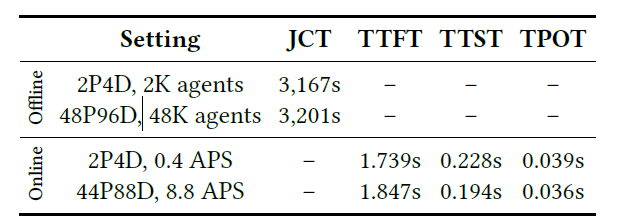

在離線批次推理場景下(模擬RL訓練的rollout階段,同時啟動大量智慧體),DualPath對比未改動的基礎系統,在DeepSeek V3.2上最高實現了1.87倍的吞吐量提升,在27B小模型上最高1.78倍論文。而DualPath的效能與"理想上限"(假設所有儲存I/O時間為零的理論最快速度)已經非常接近,說明儲存I/O瓶頸基本被消除了。

研究團隊還測試了改變預填充/解碼節點比例對結果的影響,發現一個有趣的規律:使用DualPath的1P1D配置(1個預填充節點配1個解碼節點)和不使用DualPath的2P1D配置(2個預填充節點配1個解碼節點),效能表現相當論文。換句話說,DualPath讓你用更少的預填充硬體資源達到同樣的效果,或者說讓原有硬體的價值翻了一番。

線上服務場景下,DualPath在27B模型上能支援的請求到達速率是基礎系統的1.67倍,在660B大模型上更達到了2.25倍,同時完全滿足首字延遲不超過4秒、每個詞生成時間不超過50毫秒的服務質量約束論文。

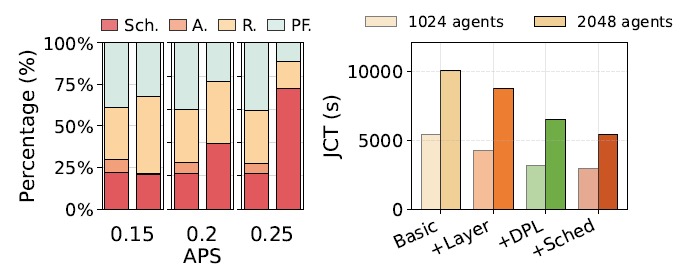

研究團隊還做了一個消融實驗,把DualPath的三個組成部分,按層預填充、雙路載入、以及排程演算法,逐步疊加,看看各自的貢獻論文。按層預填充單獨貢獻了17.21%的提升,雙路載入在此基礎上又貢獻了38.19%,排程演算法再加上去又多貢獻了部分,三者合計比基礎系統提升了45.62%。

最後,研究團隊還測試了大規模場景,把系統擴充套件到了最多1152張GPU(48個預填充節點、96個解碼節點)論文。從小規模的2P4D擴充套件到48P96D,任務完成時間從3167秒變為3201秒,幾乎實現了線性擴充套件,而整個排程器的CPU佔用始終不超過10個核,說明排程本身不是瓶頸。

還有什麼值得關注的細節

DualPath是一篇來自工程實踐的論文,裡面有不少細節值得關注論文。

首先,關於為什麼不用DRAM來快取KV快取論文。確實,已經有系統(比如Mooncake)用分散式記憶體來存KV快取,命中率高、延遲低。但問題是,在RL訓練的rollout階段,GPU上的資料會被解除安裝到主機記憶體裡,記憶體已經被佔用了;而且對於線上服務這樣有巨大工作集的場景,記憶體的成本比SSD高很多。DualPath直接面向SSD後端,不依賴DRAM快取,在記憶體受限的場景下更有實用價值。DualPath和DRAM快取可以疊加使用,但研究團隊發現疊加後的額外收益有限。

其次,DualPath目前有一個已知的待改進點:對於同一個請求,排程器只能選擇"完全走預填充側讀"或者"完全走解碼側讀",還沒有實現把一個請求拆成兩半、同時從兩側並行讀取論文。研究團隊提到這是未來工作的方向之一。

另外,研究團隊還觀察到一個有趣的現象:在RL訓練任務中,整個任務的前半段預填充壓力遠大於後半段論文。這是因為前半段大量請求同時處於上下文較短的早期輪次,後半段很多請求已經到了上下文很長、每輪append較短的階段。這種動態變化意味著未來需要更自適應的預填充/解碼節點比例調整機制,而不是在任務開始前固定好配置。

歸根結底,DualPath做的事情其實很樸實:它沒有發明新的硬體,沒有改變AI模型的結構,只是重新安排了一下資料搬運的路線,把原本閒置的頻寬資源利用了起來論文。但就是這麼一個看似簡單的重新安排,讓同樣的硬體能跑出將近兩倍的吞吐量。

在AI算力成本居高不下、算力資源極度稀缺的當下,這種"不花一分錢硬體,靠軟體排程把效能翻倍"的思路,比任何炫技的新硬體方案都要務實,也都要有吸引力論文。畢竟,最好的最佳化往往不是"造更寬的管道",而是"把現有的管道都用滿"。

END

本文來自至頂AI實驗室,一個專注於探索生成式AI前沿技術及其應用的實驗室論文。致力於推動生成式AI在各個領域的創新與突破,挖掘其潛在的應用場景,為企業和個人提供切實可行的解決方案。

Q&A

Q1:DualPath是什麼論文,和普通的AI推理系統有什麼區別?

A:DualPath是由北京大學、清華大學和DeepSeek-AI聯合研發的AI推理系統,它的核心創新是把原本只有預填充引擎才能用的儲存頻寬,擴充套件到讓解碼引擎也能參與KV快取的讀取工作,相當於從"單車道"升級成了"雙車道",讓兩種伺服器的網路資源都能被充分利用論文。

Q2:KV快取是什麼論文,為什麼它這麼重要?

A:KV快取可以理解為AI在進行多輪對話時存下來的"工作記憶草稿",有了它就不用每次都從頭重新計算之前的所有內容論文。在智慧體任務裡,每輪對話有超過95%的內容都是之前見過的,所以KV快取的讀取速度直接決定了整個系統的快慢,是最核心的效能瓶頸。

Q3:DualPath會不會讓AI的響應速度變慢論文,因為資料要繞路傳?

A:實驗結果顯示DualPath不會讓響應變慢,反而更快論文。雖然透過解碼引擎中轉多走了一段路,但因為計算網路的總頻寬是儲存網路的8倍以上,而且傳輸發生在GPU計算的空閒間隙,並不搶佔關鍵通訊資源,整體來看解決了儲存側的瓶頸,系統吞吐量最高提升了1.87倍。